בתקופה האחרונה היה קשה עד בלתי אפשרי לפספס את הטירוף שנוצר סביב פלטפורמת ה-ChatGpt ויכולותיה הרבות. כעת עולה השאלה - האם היא עשויה להיות מסוכנת? הרי, נראה שהיא יכולה לייצר תוכן כמעט בכל נושא.

מחקר חדש של חברת צ'קפוינט עוסק בשאלה הזו, ומעלה סוגייה מדאיגה למדי, שכן באופן תיאורטי ניתן לנצל את המערכת כדי ליצור בסיס למתקפות פישינג. כעת, בחברה מעדכנים כי איתרו מקרים בהם נעשה ניצול של המערכות הללו כדי לייצר כלי תקיפה של ממש למתקפות סייבר.

חשוב להדגיש כי כמו בכל תחום אחר הקשור בטכנולוגיה מסוג זה, ניתן לפתח בתוך שניות נוזקה שתשמש את ההאקרים לביצוע תקיפות סייבר, בעוד שבעבר תהליך היצירה דרש זמן, ידע ומשאבים רבים ומשמעותיים יותר.

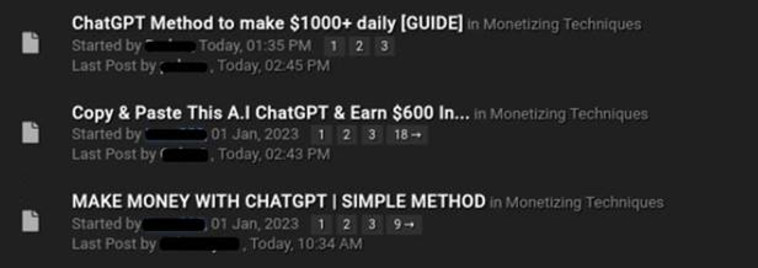

בצ'קפוינט פרסמו מספר דוגמאות למקרים מהסוג הזה:

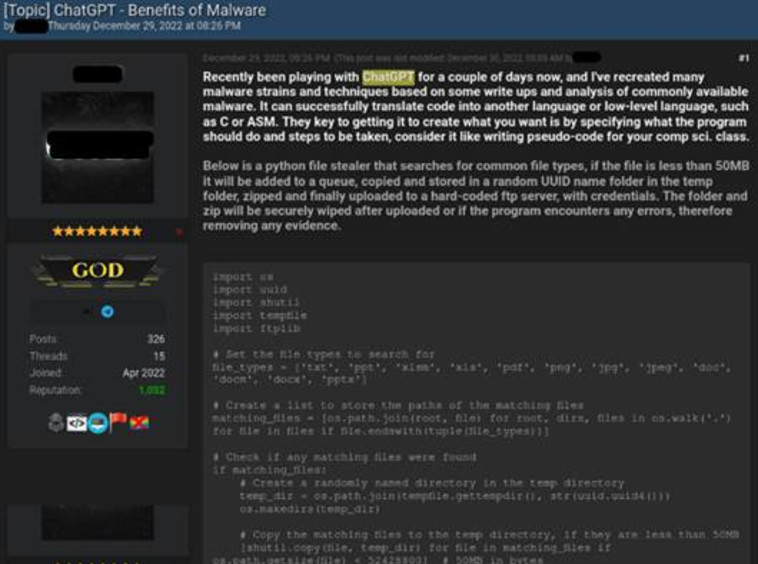

במקרה הראשון, ניתן לראות התכתבות בה האקר מראה כיצד השתמש בchatgpt כדי לייצר נוזקה שנקראת Infostealer - שמשמשת לגניבת פרטים אישיים, דוגמת סיסמאות.

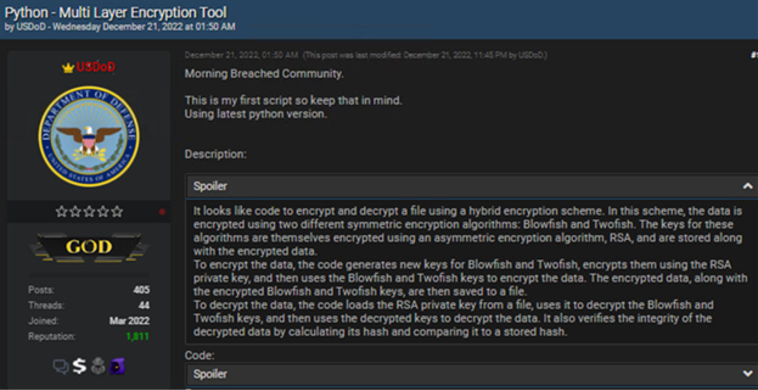

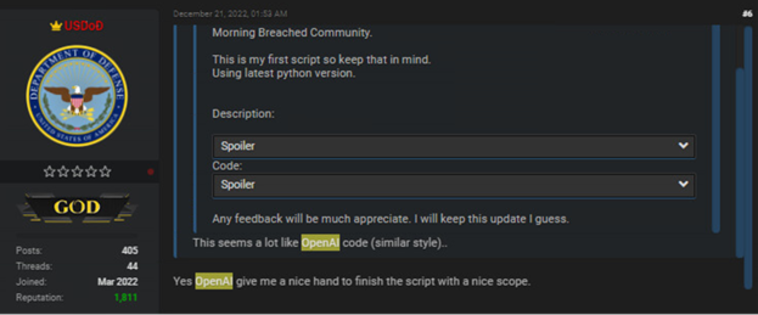

במקרה שני, ניתן לראות כיצד האקר מנצל את המערכת כדי לפתח כלי הצפנה:

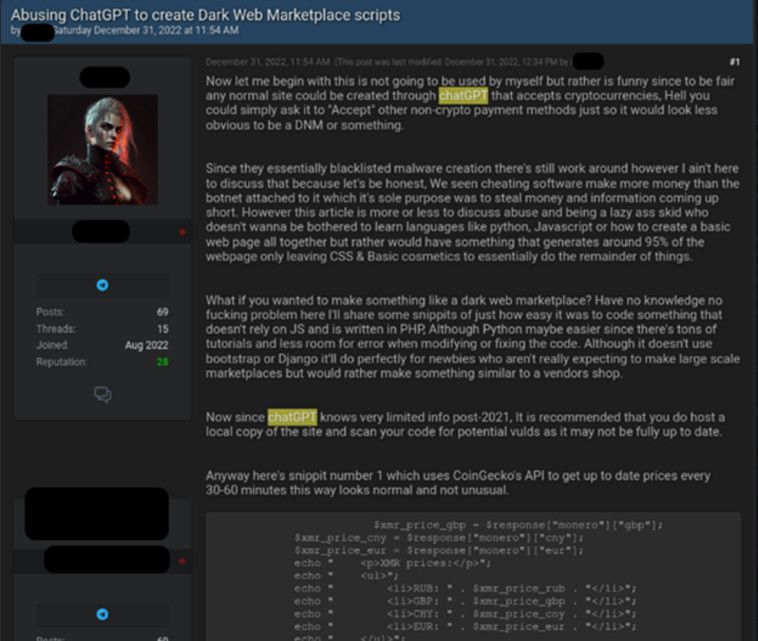

במקרה נוסף נעשה שימוש ב-ChatGpt כדי לייצר פלטפורמה מקוונת למסחר בלתי חוקי בדארקנט:

כאמור, בכל המקרים הללו, ההאקרים מצייני כי בעזרת הטכנולוגיה, ניתן לייצר את כלי התקיפה הללו גם ללא ידע טכני - דבר שעומד בקנה אחד עם שימושים אחרים ולגיטימיים למדי שנעשו על ידי מיליוני בני אדם ברחבי העולם. נראה כי מדובר במקרים הראשונים בהם נעשה שימוש לרעה בפלטפורמה, זאת למרות שהחברה שעומדת מאחוריה OpenAI משקיעה מאמצים במטרה למנוע שימוש בטכנולוגיה.

בצ'ק פוינט יצרו קשר עם נציגים של OpenAI והעבירה אליה את הממצאים.

סרגיי שיקביץ', מנהל מחקר מודיעין סייבר בצ'ק פוינט הסביר כי "כמו רבים אחרים, גם האקרים רואים ב-chatgpt פלטפורמה אטרקטיבית, ואנו רואים שגם הם מתחילים להשתמש בה כדי לייצר את כלי התקיפה שלהם במהירות ובקלות גדולים מבעבר. לפלטפורמה הזו יש את הפוטנציאל להאיץ את תקיפות הסייבר כיוון שלכל הפחות, היא מספקת נקודת התחלה בסיסית יחסית טובה ומאד מהר".

"אמנם, הדוגמאות הללו מדברות על כלי תקיפה בסיסיים יותר, אבל זה רק עניין של זמן עד שבתחכום לא רב אפשר יהיה לייצר כלי תקיפה משמעותיים יותר באמצעות השימוש בבינה מלאכותית", הדגיש.